Gretl - Caschool (logaritmica) 513j1s

This document was ed by and they confirmed that they have the permission to share it. If you are author or own the copyright of this book, please report to us by using this report form. Report 445h4w

Overview 1s532p

& View Gretl - Caschool (logaritmica) as PDF for free.

More details 6h715l

- Words: 989

- Pages: 4

CASCHOOL – GRETL REGRESSIONE LOGARITMICA TESTSCR

AVG TEST SCORE

AVGINC

DISTRICT AVERAGE INCOME (IN $1000'S)

Media dei punteggi ottenuti nelle prove di lettura e di mate Reddito medio per distretto in migliaia di dollari

(READ_SCR+MATH_SCR)/ 2

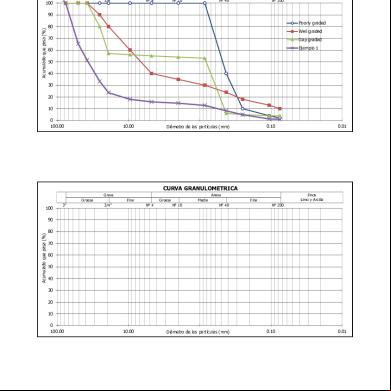

TESTSCR & AVGINC Regressione Lineare-Logaritmica Definisco una nuova variabile: L_AVGINC = ln(AVGINC) e procediamo alla regressione Modello 4: OLS, usando le osservazioni 1-420 Variabile dipendente: testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc

Coefficiente 557,832 36,4197

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

Errore Std. 3,83994 1,39694

654,1565 66546,86 0,562507 679,6967 -1659,690 3331,460

rapporto t 145,2711 26,0710

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

19,05335 12,61757 0,561461 1,15e-89 3323,379 3326,573

Fz di regressione : TESTSCR = 557,83 + 36,42 ln(AVGINC). Ricordando che ad una variazione di X dell’1 % è associata una variazione di Y pari a 0,01*β1, si può vedere che un incremento del reddito dell’1 % è associato a un incremento medio del punteggio nel test di 0,01*36,42 = 0.364 punti. Cerchiamo ora quale sia la differenza di punteggio tra il punteggio nel test di due distretti aventi reddito rispettivamente di 10.000 $ e di 11.000 $. ∆Y = β0 + 36,42 ln(11) – [ β0 + 36,42 ln(10)] = 36,42 [ ln(11) - ln(10) ] = 3,47 Cerchiamo ora quale sia la differenza di punteggio tra il punteggio nel test di due distretti aventi reddito rispettivamente di 40.000 $ e di 41.000 $. ∆Y = β0 + 36,42 ln(41) – [ β0 + 36,42 ln(40)] = 36,42 [ ln(41) - ln(40) ] = 0,899

Conlcudiamo che così come per la regressione quadratica, anch questa regressione prevede che un incremento di reddito di 1.000 $ abbia un effetto maggiore sui punteggi dei test dei distretti più poveri. Regressione Log-Lineare Definisco una nuova variabile: L_TESTSCR = ln(TESTSCR) e procediamo alla regressione Modello 6: OLS, usando le osservazioni 1-420 Variabile dipendente: l_testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 Coefficiente Errore Std. 6,43936 0,00289382 0,00284407 0,000175088

const avginc

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

6,482924 0,178232 0,498211 263,8552 1034,680 -2057,280

rapporto t 2225,2097 16,2436

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

0,029116 0,020649 0,497011 2,40e-46 -2065,360 -2062,167

Fz di regressione : ln(TESTSCR) = 6,4394 + 0,0028 AVGINC. Regressione Log-Log Modello 5: OLS, usando le osservazioni 1-420 Variabile dipendente: l_testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc

Coefficiente 6,33635 0,055419

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

Errore Std. 0,00592459 0,00214458

6,482924 0,157072 0,557783 667,7801 1061,220 -2110,359

rapporto t 1069,5006 25,8414

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

0,029116 0,019385 0,556725 1,13e-88 -2118,440 -2115,246

Fz di regressione : ln(TESTSCR) = 6,3364 + 0,0554 ln(AVGINC). Secondo questa regressione un incremento del reddito dell’1 % corrisponde a un incremento medio dello 0,0554 % del punteggio nei test. Confronto tra le regressioni (Testscr/Avginc):

R2 Corretto 0,506380 0,561461 0,497011 0,556725

Regressione Lineare Lineare-Log Log-Lineare Log-Log

L’R2 Corretto può essere usato per confrontare solo regressioni con stessa variabile dipendente, nel nostro caso cioè possiamo confrontare le regressioni • Lineare / Lineare-Log Nel nostro caso si adatta meglio ai dati la regressione lineare-log poiché ha R2 corretto maggiore rispetto alla regressione lineare (0,56 > 0,50). • Log-Lineare / Log-Log Nel nostro caso si adatta meglio ai dati la regressione log-log poiché ha R2 corretto maggiore rispetto alla regressione log-lineare (0,556 > 0,497). Non possiamo confrontare il modello lineare-logaritmico con il modello log-log poiché l’R2 Corretto misura la frazione di varianza della variabile dipendente spiegata dai regressori e poiché in questo caso le variabili dipendenti sono diverse non ha senso paragonare l’R2. Nel modellare i punteggi dei test sembra naturale discutere i risultati dei test in termini di punti piuttosto che di incrementi percentuali, per questo motivo optiamo per modelli la cui variabile dipendente sia il punteggio nel test piuttosto che il logaritmo. Regressione Lineare-Logaritmica con potenze Aggiungo le variabili: SQ_L_AVGINC = (L_AVGINC)2 e LAVG3 = (L_AVGINC)3 e procedo alla regressione Modello 8: OLS, usando le osservazioni 1-420 Variabile dipendente: testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc sq_l_avginc LAVG3

Coefficiente 486,134 113,381 -26,9109 3,06314

Media var. dipendente Somma quadr. residui R-quadro F(3, 416) Log-verosimiglianza Criterio di Schwarz

Errore Std. 79,3825 87,8836 31,7457 3,73688

654,1565 66449,86 0,563145 255,1623 -1659,383 3342,928

rapporto t 6,1239 1,2901 -0,8477 0,8197

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 0,19772 0,39709 0,41285

***

19,05335 12,63864 0,559994 6,68e-94 3326,767 3333,154

Fz di regr : TESTSCR = 486,1 + 113,4 ln(AVGINC) – 26,9(ln(AVGINC))2 + 3,0(ln(AVGINC))3 Per verificare se la specificazione logaritmica fornisce una buona interpolazione dei dati abbiamo aggiunto al modello le potenze del logaritmo: se questi termini addizionali non sono statisticamente

diversi da zero possiamo concludere che la specificazione lineare-logaritmica è adeguata nel senso che non può essere rifiutata contro una funzione polinomiale del logaritmo. Il rapporto t relativo al coefficiente della terza potenza del logaritmo è 0,82 quindi l’ipotesi nulla che β3 = 0 non può essere rifiutata ad un livello di significatività del 10 % poiché 0,82 < 1,64485. Statistica F per la verifica dell’ipotesi congiunta β2 = 0 e β3 = 0: Insieme di vincoli 1: b[sq_l_avginc] = 0 2: b[LAVG3] = 0 Statistica test: F robusta(2, 416) = 0,439222, con p-value = 0,644836 Stime vincolate: coefficiente errore std. rapporto t p-value -------------------------------------------------------------const 557,832 4,20035 132,8 0,0000 *** l_avginc 36,4197 1,57098 23,18 4,77e-077 *** sq_l_avginc 0,000000 0,000000 NA NA LAVG3 0,000000 0,000000 NA NA Errore standard della regressione = 12,6176

Poiché il p-value è 0,645 < 1,64485 questa ipotesi congiunta non è rifiutata ad un livello del 10 % . Il modello cubico logaritmico non fornisce quindi un miglioramento statisticamente significativo rispetto al modello lineare-logaritmico.

AVG TEST SCORE

AVGINC

DISTRICT AVERAGE INCOME (IN $1000'S)

Media dei punteggi ottenuti nelle prove di lettura e di mate Reddito medio per distretto in migliaia di dollari

(READ_SCR+MATH_SCR)/ 2

TESTSCR & AVGINC Regressione Lineare-Logaritmica Definisco una nuova variabile: L_AVGINC = ln(AVGINC) e procediamo alla regressione Modello 4: OLS, usando le osservazioni 1-420 Variabile dipendente: testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc

Coefficiente 557,832 36,4197

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

Errore Std. 3,83994 1,39694

654,1565 66546,86 0,562507 679,6967 -1659,690 3331,460

rapporto t 145,2711 26,0710

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

19,05335 12,61757 0,561461 1,15e-89 3323,379 3326,573

Fz di regressione : TESTSCR = 557,83 + 36,42 ln(AVGINC). Ricordando che ad una variazione di X dell’1 % è associata una variazione di Y pari a 0,01*β1, si può vedere che un incremento del reddito dell’1 % è associato a un incremento medio del punteggio nel test di 0,01*36,42 = 0.364 punti. Cerchiamo ora quale sia la differenza di punteggio tra il punteggio nel test di due distretti aventi reddito rispettivamente di 10.000 $ e di 11.000 $. ∆Y = β0 + 36,42 ln(11) – [ β0 + 36,42 ln(10)] = 36,42 [ ln(11) - ln(10) ] = 3,47 Cerchiamo ora quale sia la differenza di punteggio tra il punteggio nel test di due distretti aventi reddito rispettivamente di 40.000 $ e di 41.000 $. ∆Y = β0 + 36,42 ln(41) – [ β0 + 36,42 ln(40)] = 36,42 [ ln(41) - ln(40) ] = 0,899

Conlcudiamo che così come per la regressione quadratica, anch questa regressione prevede che un incremento di reddito di 1.000 $ abbia un effetto maggiore sui punteggi dei test dei distretti più poveri. Regressione Log-Lineare Definisco una nuova variabile: L_TESTSCR = ln(TESTSCR) e procediamo alla regressione Modello 6: OLS, usando le osservazioni 1-420 Variabile dipendente: l_testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 Coefficiente Errore Std. 6,43936 0,00289382 0,00284407 0,000175088

const avginc

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

6,482924 0,178232 0,498211 263,8552 1034,680 -2057,280

rapporto t 2225,2097 16,2436

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

0,029116 0,020649 0,497011 2,40e-46 -2065,360 -2062,167

Fz di regressione : ln(TESTSCR) = 6,4394 + 0,0028 AVGINC. Regressione Log-Log Modello 5: OLS, usando le osservazioni 1-420 Variabile dipendente: l_testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc

Coefficiente 6,33635 0,055419

Media var. dipendente Somma quadr. residui R-quadro F(1, 418) Log-verosimiglianza Criterio di Schwarz

Errore Std. 0,00592459 0,00214458

6,482924 0,157072 0,557783 667,7801 1061,220 -2110,359

rapporto t 1069,5006 25,8414

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 <0,00001

*** ***

0,029116 0,019385 0,556725 1,13e-88 -2118,440 -2115,246

Fz di regressione : ln(TESTSCR) = 6,3364 + 0,0554 ln(AVGINC). Secondo questa regressione un incremento del reddito dell’1 % corrisponde a un incremento medio dello 0,0554 % del punteggio nei test. Confronto tra le regressioni (Testscr/Avginc):

R2 Corretto 0,506380 0,561461 0,497011 0,556725

Regressione Lineare Lineare-Log Log-Lineare Log-Log

L’R2 Corretto può essere usato per confrontare solo regressioni con stessa variabile dipendente, nel nostro caso cioè possiamo confrontare le regressioni • Lineare / Lineare-Log Nel nostro caso si adatta meglio ai dati la regressione lineare-log poiché ha R2 corretto maggiore rispetto alla regressione lineare (0,56 > 0,50). • Log-Lineare / Log-Log Nel nostro caso si adatta meglio ai dati la regressione log-log poiché ha R2 corretto maggiore rispetto alla regressione log-lineare (0,556 > 0,497). Non possiamo confrontare il modello lineare-logaritmico con il modello log-log poiché l’R2 Corretto misura la frazione di varianza della variabile dipendente spiegata dai regressori e poiché in questo caso le variabili dipendenti sono diverse non ha senso paragonare l’R2. Nel modellare i punteggi dei test sembra naturale discutere i risultati dei test in termini di punti piuttosto che di incrementi percentuali, per questo motivo optiamo per modelli la cui variabile dipendente sia il punteggio nel test piuttosto che il logaritmo. Regressione Lineare-Logaritmica con potenze Aggiungo le variabili: SQ_L_AVGINC = (L_AVGINC)2 e LAVG3 = (L_AVGINC)3 e procedo alla regressione Modello 8: OLS, usando le osservazioni 1-420 Variabile dipendente: testscr Errori standard robusti rispetto all'eteroschedasticità, variante HC1 const l_avginc sq_l_avginc LAVG3

Coefficiente 486,134 113,381 -26,9109 3,06314

Media var. dipendente Somma quadr. residui R-quadro F(3, 416) Log-verosimiglianza Criterio di Schwarz

Errore Std. 79,3825 87,8836 31,7457 3,73688

654,1565 66449,86 0,563145 255,1623 -1659,383 3342,928

rapporto t 6,1239 1,2901 -0,8477 0,8197

SQM var. dipendente E.S. della regressione R-quadro corretto P-value(F) Criterio di Akaike Hannan-Quinn

p-value <0,00001 0,19772 0,39709 0,41285

***

19,05335 12,63864 0,559994 6,68e-94 3326,767 3333,154

Fz di regr : TESTSCR = 486,1 + 113,4 ln(AVGINC) – 26,9(ln(AVGINC))2 + 3,0(ln(AVGINC))3 Per verificare se la specificazione logaritmica fornisce una buona interpolazione dei dati abbiamo aggiunto al modello le potenze del logaritmo: se questi termini addizionali non sono statisticamente

diversi da zero possiamo concludere che la specificazione lineare-logaritmica è adeguata nel senso che non può essere rifiutata contro una funzione polinomiale del logaritmo. Il rapporto t relativo al coefficiente della terza potenza del logaritmo è 0,82 quindi l’ipotesi nulla che β3 = 0 non può essere rifiutata ad un livello di significatività del 10 % poiché 0,82 < 1,64485. Statistica F per la verifica dell’ipotesi congiunta β2 = 0 e β3 = 0: Insieme di vincoli 1: b[sq_l_avginc] = 0 2: b[LAVG3] = 0 Statistica test: F robusta(2, 416) = 0,439222, con p-value = 0,644836 Stime vincolate: coefficiente errore std. rapporto t p-value -------------------------------------------------------------const 557,832 4,20035 132,8 0,0000 *** l_avginc 36,4197 1,57098 23,18 4,77e-077 *** sq_l_avginc 0,000000 0,000000 NA NA LAVG3 0,000000 0,000000 NA NA Errore standard della regressione = 12,6176

Poiché il p-value è 0,645 < 1,64485 questa ipotesi congiunta non è rifiutata ad un livello del 10 % . Il modello cubico logaritmico non fornisce quindi un miglioramento statisticamente significativo rispetto al modello lineare-logaritmico.